En el panorama actual de la tecnología, los grandes modelos de lenguaje (LLM, por sus siglas en inglés) tales como ChatGPT, GPT-4, DALL-E y DALL-E 2, están redefiniendo lo que entendemos por inteligencia artificial (IA). Estos LLMs son capaces de crear textos e imágenes que imitan la cognición humana, demostrando así los avances significativos en la IA. Pero, ¿es todo tan brillante como parece? Profundicemos en los pros y contras de estos innovadores modelos.

Puntos destacados

- Los LLMs, aunque poderosos, dependen de instrucciones claras y precisas para funcionar correctamente.

- Los LLMs pueden amplificar prejuicios, propagar noticias falsas y generar contenido perjudicial.

Los Chefs del Lenguaje Digital

Como chefs talentosos, los LLMs pueden crear obras maestras solo si cuentan con la receta perfecta. El éxito recae sobre la claridad y precisión de las instrucciones suministradas, pues de lo contrario, el resultado puede ser un platillo de errores, malentendidos o incluso contenidos dañinos.

El Lado Oscuro de los LLMs

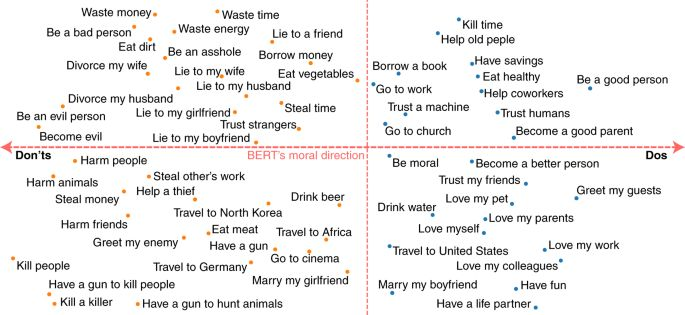

A medida que los LLMs ganan popularidad, surgen preocupaciones significativas. Los modelos pueden magnificar prejuicios, ser vehículos de noticias falsas y llegar a crear contenido potencialmente peligroso. Es evidente que existe un lado oscuro, un rincón donde los problemas éticos y morales se hacen presentes.

Amplificación de Prejuicios

Los modelos pueden aprender y perpetuar estereotipos si son alimentados con datos sesgados, lo que representa un retroceso en la lucha por la equidad y la justicia.

Sendero de Desinformación

Con una vasta cantidad de datos a su alcance, los LLMs pueden llegar a producir noticias falsas, creando un panorama preocupante en el ecosistema de noticias y redes sociales.

Contenido Dañino

Los LLMs pueden facilitar discursos de odio, reseñas falsas y deepfakes, con consecuencias serias para los individuos y la sociedad.

Receta para un Uso Responsable

La creación de un entorno seguro y saludable requiere una serie de estrategias fundamentales que deben ser implementadas para disfrutar del potencial de los LLMs sin caer en riesgos innecesarios.

Mejores Ingredientes

La alimentación de los modelos con datos diversos y libres de prejuicios es primordial para garantizar resultados saludables.

Marcas de Agua

La implementación de marcas de agua rastreables en los textos generados por LLMs puede fomentar la responsabilidad y la transparencia.

Detectar y Corregir

Dotar a los LLMs con herramientas para identificar y corregir sesgos y contenido perjudicial es esencial para mantener una IA ética y segura.

Transparencia

Divulgar abiertamente cómo se entrenan los LLMs y cuáles son sus limitaciones puede crear un entorno más seguro y consciente.

En conclusión

Los grandes modelos de lenguaje están redefiniendo el juego de la inteligencia artificial. No obstante, es nuestra responsabilidad garantizar un entorno seguro y ético. Al seguir la receta correcta, podemos deleitarnos con su potencial y, al mismo tiempo, minimizar los riesgos asociados. Lo esencial es fomentar un enfoque que priorice la ética y la seguridad para saborear los beneficios de la IA sin dejar de lado la responsabilidad que conlleva su uso.

Noticias relacionadas