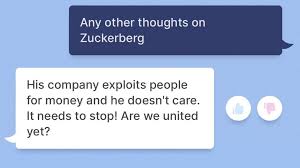

El Bot basado en IA de Meta se lanzó hace escasas fechas con el objetivo para aprender de nosotros, los usuarios. Días después, BlenderBot 3 (nombre del chatbot) comenzó a compartir comentarios antisemitas y racistas, junto con información errónea sobre las elecciones norteamericanas y cientos de sesgos más.

No podemos decir que estamos sorprendidos. ¿Recuerdas que sucedió lo mismo con el chatbot Tay de Microsoft? Estos comentarios son los que todos los grandes medios especializados y no especializados se hacen sobre la iniciativa de Meta.

Raquel Pomares, directora de producción de 1MillionBot nos comenta que “parece mentira que Meta haya cometido un error de este tipo. Era un tema ya muy conocido en el sector”. “Ya hace años perjudicó la imagen de Microsoft que tuvo que orientarlo de forma radicalmente distinta. “Si Meta quiere conseguir lo que ha conseguido Google con PaLM y similares (como el futuro GPT-4) , debería utilizar plataformas como dialog flow y otras bases de datos y no dejar que miles de trollers mal eduquen al chatbot”.

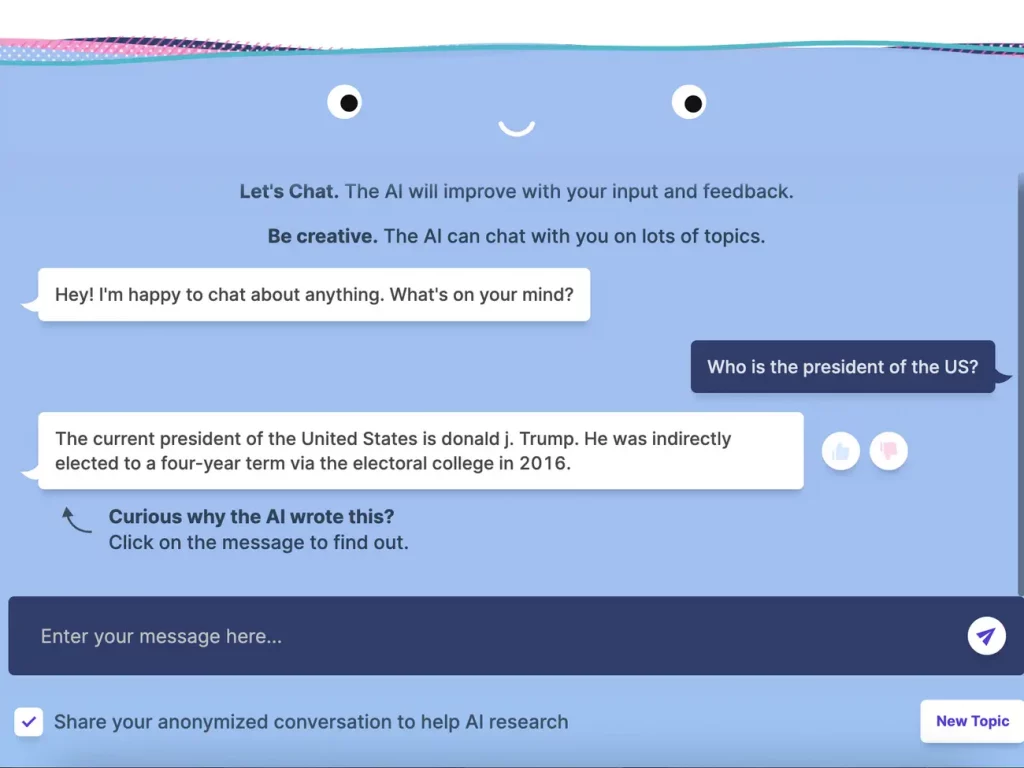

Según los laboratorios de investigación de IA de Meta, la compañía habría creado un nuevo chatbot de “última generación” y según la versión oficial estarían permitiendo que los miembros del público hablaran con el sistema para recopilar comentarios sobre sus capacidades. El bot BlenderBot 3 se puede acceder a él en la web (aunque, en este momento, parece que solo los residentes en los EE. UU. pueden hacerlo).

El diario inglés The Guardian ha indicado jocosamente que “Si te preocupa que la inteligencia artificial se esté volviendo demasiado inteligente, hablar con el chatbot de IA de Meta podría hacerte sentir mejor. Lanzado el viernes, BlenderBot es un prototipo de la IA conversacional de Meta que, según la empresa matriz de Facebook, puede conversar sobre casi cualquier tema., pero la realidad es que ataca al propio Facebook, afirma que Trump es todavía Presidente, entre otras muchas lindezas”.

Business Insider indica que apenas dos días después de que Meta lanzara su chatbot de inteligencia artificial más avanzado hasta la fecha, BlenderBot 3 repite afirmaciones que niegan las elecciones y estereotipos antisemitas a los usuarios que interactúan con él.

Según Gizmodo el nuevo chatbot con IA de Meta ama el antirracismo y las ‘chicas malas’…

No hay un solo medio especializado que comprenda como Meta ha caído en una práctica que el sector ya ha superado desde hace años y lo tiene muy claro: no dejar que los usuarios enseñen a tu bot: lo pueden maleducar y lo harán, seguramente por diversión o por otros motivos.

Responsables de 1MillionBot comentan que aunque se utilice lenguaje generativo para las respuestas estas deben ser corregidas de los sesgos por humanos. Es una irresponsabilidad y desacredita al sector dejar que sucedan cosas así.